1 jar加载

查看源码运行脚本:%SPARK_HOME%\bin\spark-class2.cmd 关于jar包加载的说明。

1.1 将包放到文件夹路径%SPARK_HOME%\jars里

anaconda是一样的哈,不需要额外改路径。

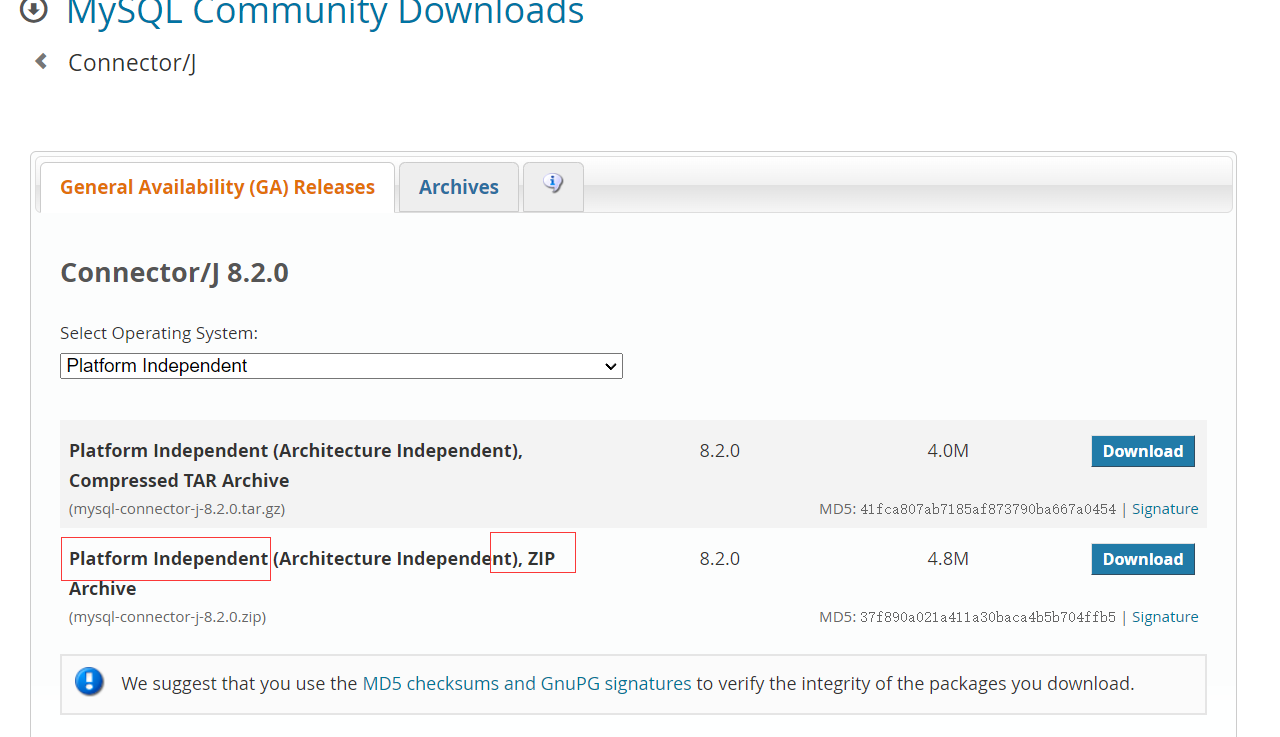

下载地址去mysql官网下哈,下载对应mysql版本的。https://dev.mysql.com/downloads/connector/j/

解压后就是jar包。

1.2 重启jupyter后可以生效。

2 脚本里import pymysql

然后可以直接写连接串了。

df2 = spark.read \ .format("jdbc") \ .option("url", url_Mysql) \ .option("dbtable", "apps_small") \ .option("user", "spark") \ .option("password", "123456") \ .load()