tensorrt

深度学习模型部署TensorRT为何如此优秀?

一、前言 PyTorch模型的高性能部署问题,主要关注两个方面:高度优化的算子和高效运行计算图的架构和runtime。python有快速开发以及验证的优点,但是相比C++来说速度较慢而且比较费内存,一般高性能场景都是使用C++去部署,尽量避免使用python环境。 TensorRT为什么那么快,因为 ......

神经网络量化流程(第一讲TensorRT)

TensorRT量化工具,支持PTQ和QAT量化 基本流程:读取模型-》转化为IR进行图分析,做一些优化策略 一、TensorRT量化模式 TensorRT有两种量化模式:分别是implicitly以及explicitly量化,前者是隐式量化,在7.0及之前版本用的较多;后者显式量化在8.0版本后才 ......

使用Tensorrt部署,C++ API yolov7_pose模型

使用Tensorrt部署,C++ API yolov7_pose模型 虽然标题叫部署yolov7_pose模型,但是接下来的教程可以使用Tensorrt部署任何pytorch模型。 仓库地址:https://github.com/WongKinYiu/yolov7/tree/pose 系统版本:ub ......

YOLOv7 部署到 TensorRT(C++ )

TensorRT 概述 TensorRT 是由 Nvidia 发布的一个机器学习框架,用于在其硬件上运行机器学习推理。其能针对 Nvidia 系列硬件进行优化加速,实现最大程度的利用 GPU 资源,提升推理性能。在训练了神经网络之后,TensorRT 可以对网络进行压缩、优化以及运行时部署,并且没有 ......

使用TensorRT-LLM进行高性能推理

LLM的火爆之后,英伟达(NVIDIA)也发布了其相关的推理加速引擎TensorRT-LLM。TensorRT是nvidia家的一款高性能深度学习推理SDK。此SDK包含深度学习推理优化器和运行环境,可为深度学习推理应用提供低延迟和高吞吐量。而TensorRT-LLM是在TensorRT基础上针对大 ......

TensorRT推理YOLOv5

一、查看cuda和cudnn的安装版本 1.1 查看cuda的版本信息 nvcc --version # 输出 nvcc: NVIDIA (R) Cuda compiler driver Copyright (c) 2005-2020 NVIDIA Corporation Built on Thu_ ......

tensorrt学习(三)

继续整理tensorrt的学习资料,方便后续查看. (文章内容大部分摘取于网络资源) ## 1 int8量化 int8量化就是将网络的权重由float32类型缩放为int8类型,同时记录缩放的scale。为了尽可能的不丢失精度,需要采用标定图片来确定缩放的范围。 ### 1.1 int8量化原理 * ......

tensorrt学习(二)

继续整理tensorrt的学习资料,方便后续查看 ## 1. tensorrt插件 对于tensorrt不支持的算子,可以通过plugin插件的方式,自己实现。这里采用在pytorch中自定义一个算子,导出到onnx中,然后实现一个tensorrt plugin来解析这个自定义算子。 ### 1.1 ......

tensorrt学习(一)

整理下tensorrt学习资料,方便后续查找。(文章内容大部分摘取于网络资源) # 1. tensorrt介绍 安装: https://docs.nvidia.com/deeplearning/sdk/tensorrt-install-guide/index.html tensorrt python ......

手把手教你使用LabVIEW TensorRT实现图像分类实战(含源码)

> 🏡博客主页: [virobotics(仪酷智能):LabVIEW深度学习、人工智能博主](https://blog.csdn.net/virobotics) > >🍻本文由[virobotics(仪酷智能)](https://blog.csdn.net/virobotics)原创首发 > ......

ubuntu20.04 安装 cuda11.8 + cuDNN v8.9.0 (July 11th, 2023), for CUDA 11.x + TensorRT-8.6.1

根据文档:https://docs.nvidia.com/deeplearning/tensorrt/archives/tensorrt-861/install-guide/index.html TensorRT 8.6.1 支持:cuda11.8, cuDNN v8.9.0 ### 1. 安装 c ......

TensorRT 模型加密杂谈

在大多数项目交付场景中,经常需要对部署模型进行加密。模型加密一方面可以防止泄密,一方面可以便于模型跟踪管理,防止混淆。 由于博主使用的部署模型多为TensorRT格式,这里以TensorRT模型为例,讲解如何对模型进行加密、解密以及推理加密模型。 ## 加密算法的选择和支持的库 [Crypto++] ......

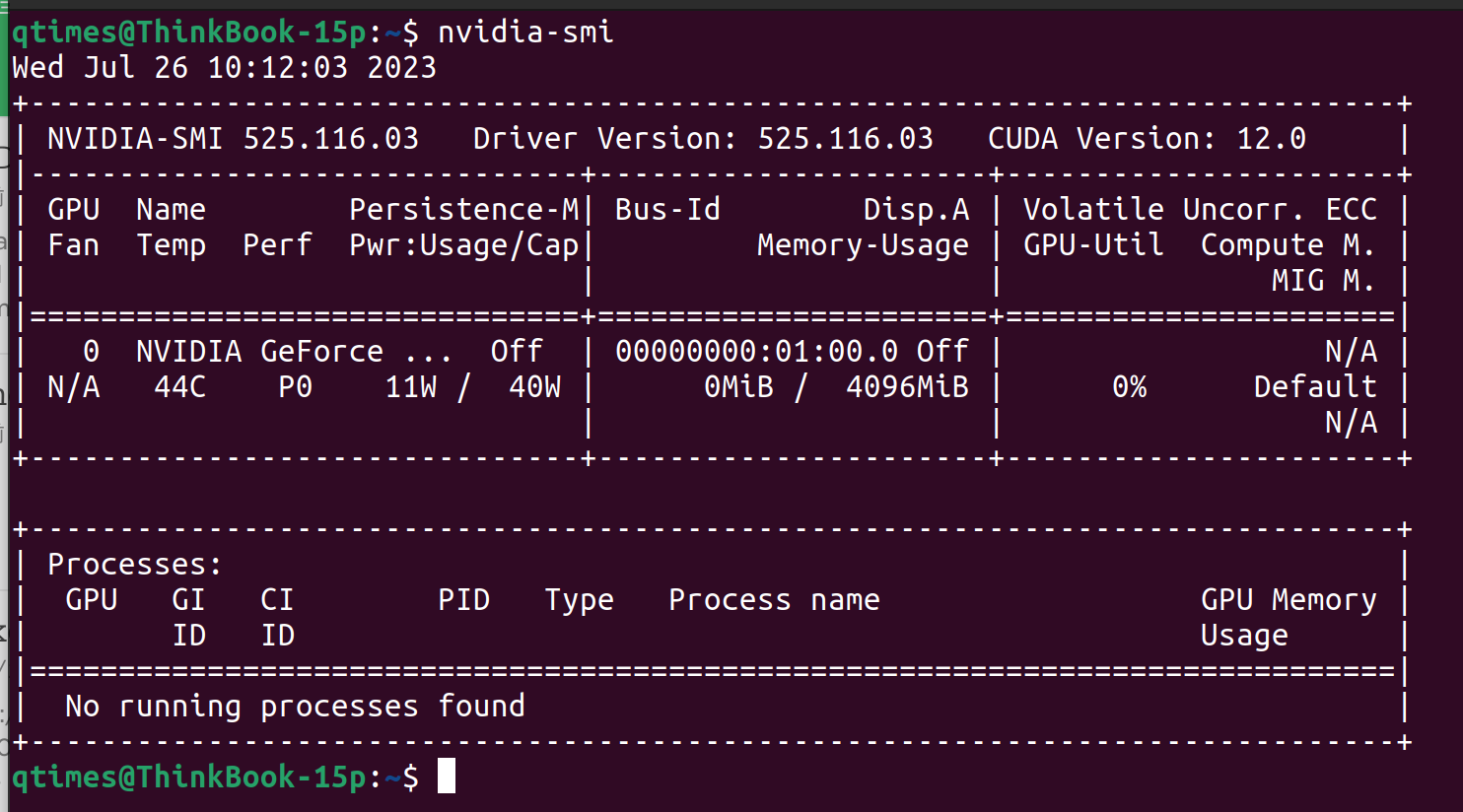

ubuntu22.04 cuda cudnn tensorRT安装

1:查看当前安装驱动版本信息  driver version: 525.116.03 cuda version: 12 ......

LLM + TensorRT 采坑记录

TensorRT的使用,尝试对LLM进行加速。本文为采坑记录 环境:ubuntu20.04, cuda 12.2, pytorch 2.0.1, tensorrt 8.6.1, torch_tensorrt 1.4.0, transformer 0.6.0 设备有限,仅打算尝试[opt-1.3b]( ......

ubuntu 22.04离线安装cuda 11.7.1、cudnn 8.9.3.28、nccl 2.18.3、tensorrt 8.6.1

最近在使用飞桨OCR,有几个特殊的符号需要进行识别,手上只有两台机器,一台1080TI单卡(windows 11),一台1080Ti双卡(linux 22.04),习惯性追新到飞桨最高支持的cuda11.7,其实1080Ti到cuda10就够用了,后面的新版本差没有明显的性能提升。 windows上 ......

机器学习 - Torch-TensorRT 推理加速

# 机器学习 - Torch-TensorRT 推理加速 Torch-TensorRT 作为 TorchScript 的扩展。 它优化并执行兼容的子图,让 PyTorch 执行剩余的图。 PyTorch 全面而灵活的功能集与 Torch-TensorRT 一起使用,解析模型并将优化应用于图的 Ten ......

TensorRT源码编译

[toc] # 1.参考资料 tensorrt编译 https://zhuanlan.zhihu.com/p/346307138 tensorrt相关指南 https://zhuanlan.zhihu.com/p/382728131 使用 TensorRT 加速深度学习推理 https://deve ......

opencv与tensorrt安装

opencv安装参考: https://blog.csdn.net/wxyczhyza/article/details/128968849 tensorrt安装: sudo tar -xvf TensorRT-8.5.1.7.Linux.x86_64-gnu.cuda-11.8.cudnn8.6.t ......

Ubuntu安装CUDA工具包、cuDNN、TensorRT

简介一下这三个东西: CUDA:是一种针对支持 CUDA 功能的 GPU(图形处理器)的 C 语言开发环境。 cuDNN:是GPU加速的用于深度神经网络的原语库。cuDNN为标准例程提供了高度优化的实现,例如向前和向后卷积,池化,规范化和激活层。 TensorRT:是nvidia家的一款高性能深度学 ......

OpenCV 和 TensorRT 之间的数据转换 HWC to CHW

TensorRT做图像相关模型部署的时候,导入图片的数据存储往往是BHWC(Batch, Height, Width, Channel), 而TensorRT推理的时候是BCHW. OpenCV 和 TensorRT 之间的数据转换(BHWC to BCHW),一般是所有元素遍历赋值: cv::Ma ......

【模型部署 01】C++实现分类模型(以GoogLeNet为例)在OpenCV DNN、ONNXRuntime、TensorRT、OpenVINO上的推理部署

深度学习领域常用的基于CPU/GPU的推理方式有OpenCV DNN、ONNXRuntime、TensorRT以及OpenVINO。这几种方式的推理过程可以统一用下图来概述。整体可分为模型初始化部分和推理部分,后者包括步骤2-5。 以GoogLeNet模型为例,测得几种推理方式在推理部分的耗时如下: ......

yolov7使用TensorRT加速

首先将yolo7的代码进行修改 修改 ./model/yolo.py 中的 Detect 类的 forward 函数如下: def forward(self, x): # x = x.copy() # for profiling z = [] # inference output self.trai ......

TensorRT代码框架

TensorRT是一个用于高性能深度学习推理的SDK,它可以将已经训练好的网络转换为TensorRT引擎,从而提高推理速度和效率。要使用TensorRT,你需要以下几个步骤: 安装TensorRT和相关的系统包,如CUDA、cuDNN、Python等。 选择一个深度学习框架,如PyTorch、Ten ......

自动驾驶图像全景分隔,基于HRnetSegmentation从训练工程到tensorRT工程部署Demo闭环一套,包含训练工程及?

自动驾驶图像全景分隔,基于HRnetSegmentation从训练工程到tensorRT工程部署Demo闭环一套,包含训练工程及部署工程,和环境的配置说明,已在实际项目中使用。大厂自动驾驶工程师沉淀实实在在的工作经验总结资料是一线自动驾驶工程师辛苦工作的结果。ID:3150671806789047 ......

自动驾驶图像分类,基于HRnet从训练工程到tensorRT工程部署Demo闭环一套,包含训练工程及部署工程,和环境?

自动驾驶图像分类,基于HRnet从训练工程到tensorRT工程部署Demo闭环一套,包含训练工程及部署工程,和环境的配置说明,已在实际项目中使用。大厂自动驾驶工程师沉淀资料是一线自动驾驶工程师辛苦工作的结果ID:5150672485127196 ......

自动驾驶车道线检测,基于LaneLine Detect从训练工程到tensorRT工程部署Demo闭环一套,包含训练工程及部署?

自动驾驶车道线检测,基于LaneLine Detect从训练工程到tensorRT工程部署Demo闭环一套,包含训练工程及部署工程,和环境的配置说明,已在实际项目中使用。大厂自动驾驶工程师沉淀实实在在的工作经验总结资料是一线自动驾驶工程师辛苦工作的结果ID:7950671420904511 ......

Linux安装cuda,cudann,tensorRT

cuda官网链接 https://developer.nvidia.com/cuda-toolkit-archive 别人的链接链接 https://zhuanlan.zhihu.com/p/72298520 配置环境变量 export LD_LIBRARY_PATH=$LD_LIBRARY_PAT ......

用C++部署yolov5+deepsort+tensorrt实现目标跟踪

本文已参与「新人创作礼」活动,一起开启掘金创作之路。 一、参考资料 Jetson 系列——基于yolov5和deepsort的多目标头部识别,跟踪,使用tensorrt和c++加速 二、相关介绍 2.1 重要说明 ==该项目能部署在Jetson系列的产品,也能部署在X86 服务器中。== 2.2 ......

tensorrt的VS props配置

版本: TensorRT-8.5.3.1.Windows10.x86_64.cuda-11.8.cudnn8.6 cuda_11.8.0_522.06_windows cudnn-windows-x86_64-8.6.0.163_cuda11-archive Zlib OpenCV 4.7.0 安装 ......